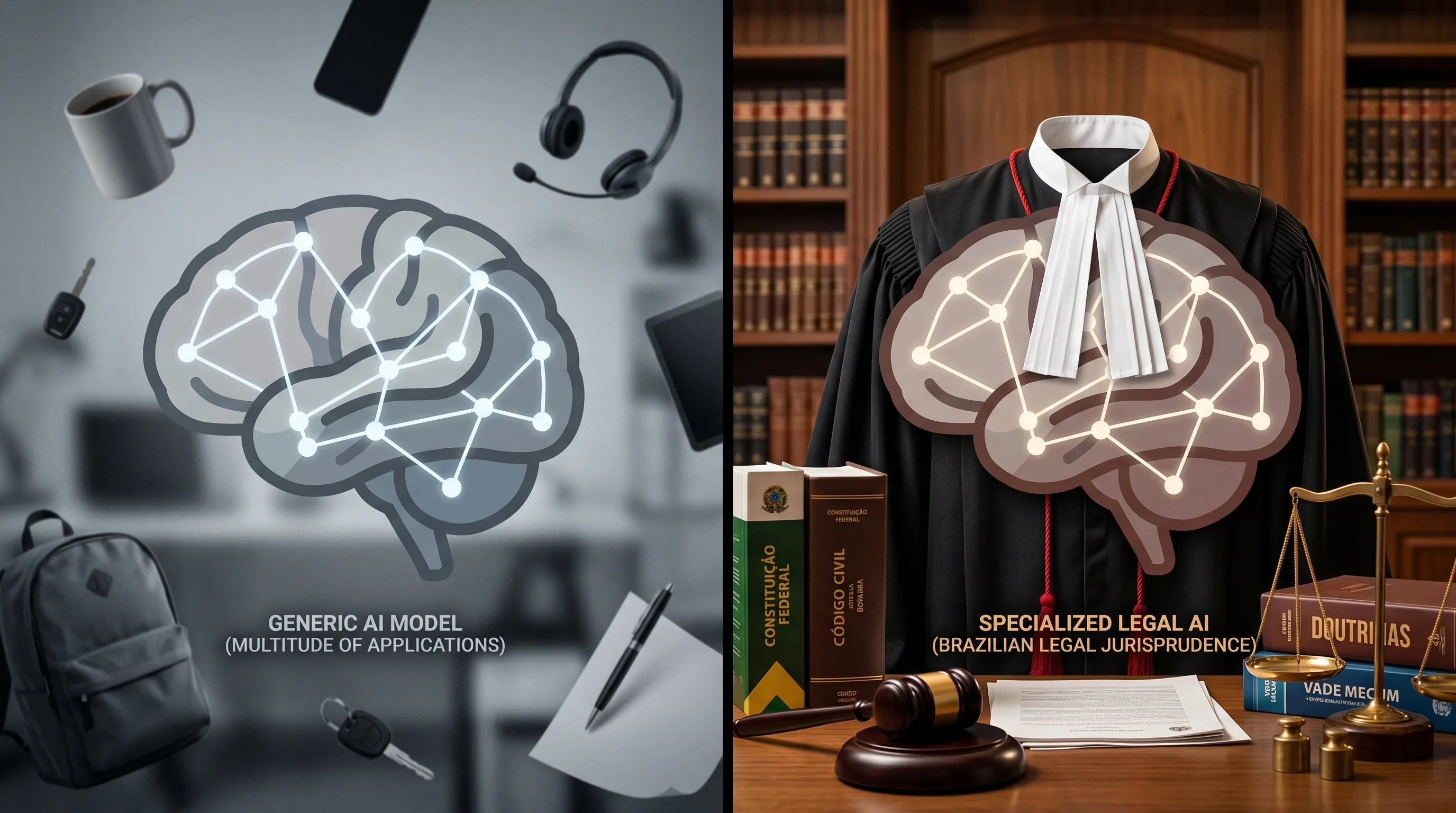

Você já abriu o ChatGPT para pesquisar uma jurisprudência rápida? Já colou um contrato inteiro num chatbot para "ver o que ele acha"? Se a resposta é sim, você não está sozinho. Uma pesquisa da Thomson Reuters de 2024 mostrou que 79% dos profissionais jurídicos já experimentaram ferramentas de IA generativa no trabalho. O problema é que a grande maioria fez isso com ferramentas genéricas — desenhadas para responder sobre receitas de bolo, código de programação e resumos de filmes com a mesma naturalidade que tentam responder sobre direito processual civil brasileiro.

Este artigo não é um ataque ao ChatGPT. Ele é uma ferramenta extraordinária para diversas tarefas. Mas quando o assunto é advocacia — onde um parágrafo errado pode resultar em multa, sanção disciplinar ou perda de causa — a diferença entre uma IA genérica e uma IA especializada não é um detalhe técnico. É uma questão de responsabilidade profissional.

A Tentação da IA Gratuita: Por Que Todo Advogado Começa Pelo ChatGPT

É perfeitamente compreensível. O ChatGPT é gratuito, acessível pelo navegador, e responde em segundos. Você digita "resuma os requisitos da tutela antecipada no CPC" e recebe um texto fluido, bem escrito e aparentemente correto. A experiência é sedutora: parece que você tem um estagiário incansável, disponível 24 horas.

Mas essa fluência é justamente a armadilha. Modelos de linguagem genéricos são treinados para gerar texto estatisticamente plausível, não juridicamente correto. O modelo não "sabe" direito — ele prevê qual palavra vem depois da outra. Quando o assunto está dentro do vasto corpus de treinamento, o resultado frequentemente acerta. Quando não está — e o modelo não avisa que não sabe — ele inventa. Com a mesma confiança. Com a mesma fluência. E é aí que começa o desastre.

Os 3 Perigos Reais de Usar IA Genérica na Advocacia

1. Alucinações jurídicas: casos inventados, leis fantasmas

O caso mais famoso do mundo aconteceu em Nova York. Em junho de 2023, o advogado Steven Schwartz, do escritório Levidow, Levidow & Oberman, usou o ChatGPT para pesquisar jurisprudência no caso Mata v. Avianca. O modelo gerou seis decisões judiciais que simplesmente não existiam. Nomes de juízes reais, números de processos verossímeis, citações no formato correto — tudo fabricado. O juiz Kevin Castel aplicou multa de US$ 5.000 ao advogado e ao colega que assinou a peça, além de exigir que notificassem todos os juízes citados nas decisões fictícias.

O Brasil já tem seus próprios episódios documentados:

- TSE (2024): Advogados foram flagrados citando jurisprudência inexistente gerada por IA em ações eleitorais. O tribunal emitiu alerta formal sobre o uso de ferramentas generativas sem verificação.

- TJ-PR (2024-2025): Magistrados paranaenses identificaram petições com fundamentação jurídica fabricada, incluindo números de acórdãos que não correspondiam a nenhum julgado real.

- TRT-12 (2025): Desembargadores de Santa Catarina documentaram casos de alucinações em recursos trabalhistas, com citação de precedentes vinculantes que nunca existiram.

Sanções Reais por Alucinações de IA no Judiciário

O CNJ, por meio da Resolução 332/2020 e suas atualizações, estabelece que a responsabilidade pelo conteúdo de peças processuais permanece integralmente do advogado, independentemente de ter sido gerado por IA. As consequências documentadas incluem: multa por litigância de má-fé (art. 81, CPC), condenação em honorários sucumbenciais majorados, instauração de procedimento disciplinar na OAB e, em casos graves, perda de credibilidade permanente perante o juízo. A Resolução 615/2025 do CNJ tornou obrigatória a declaração de uso de IA em peças judiciais — omitir essa informação é infração autônoma.

2. Violação da LGPD: seus dados do cliente na nuvem alheia

Quando você cola um contrato, uma petição ou dados pessoais de um cliente no ChatGPT, essas informações trafegam para servidores da OpenAI nos Estados Unidos. A política de uso da OpenAI deixa claro que, na versão gratuita e em parte dos planos pagos, os dados podem ser utilizados para treinamento do modelo. Isso significa que o nome do seu cliente, os valores do contrato e os detalhes da estratégia processual podem, teoricamente, influenciar respostas futuras para outros usuários.

Para advogados brasileiros, isso configura potencial violação de múltiplos dispositivos:

- LGPD (Lei 13.709/2018): Transferência internacional de dados pessoais sem base legal adequada (arts. 33 a 36).

- Estatuto da OAB (Lei 8.906/94): Quebra do sigilo profissional (art. 7, inciso II).

- Código de Ética da OAB: Violação do dever de confidencialidade (art. 36).

A ANPD já sinalizou, em suas diretrizes de 2025 sobre IA, que o uso de ferramentas que transferem dados pessoais para servidores estrangeiros sem consentimento específico e sem avaliação de impacto (RIPD) pode gerar sanções que vão de advertência até multa de 2% do faturamento.

3. Exposição ao CLOUD Act: o governo americano pode acessar seus dados

Este é o risco menos conhecido e mais grave. O CLOUD Act (Clarifying Lawful Overseas Use of Data Act), aprovado pelo Congresso dos EUA em 2018, permite que autoridades americanas exijam de empresas de tecnologia sediadas nos EUA — como OpenAI, Google e Microsoft — a entrega de dados armazenados em seus servidores, independentemente de onde esses dados tenham se originado.

Em termos práticos: se você colou um contrato sigiloso no ChatGPT e o FBI ou o DOJ americano emitir uma ordem judicial, a OpenAI é legalmente obrigada a entregar esses dados. Nenhuma notificação ao advogado ou ao cliente brasileiro é necessária. E isso não é teoria — é legislação vigente e aplicada.

Para escritórios que trabalham com clientes corporativos, disputas societárias ou contratos internacionais, a exposição ao CLOUD Act pode ser um risco existencial.

O que é RAG? (Retrieval-Augmented Generation)

RAG é a tecnologia que transforma uma IA genérica em uma IA especializada. Em vez de a IA "inventar" respostas a partir do que aprendeu na internet, o sistema RAG funciona em duas etapas: primeiro, ele busca informações relevantes dentro dos seus próprios documentos (contratos, peças processuais, doutrina); depois, a IA gera a resposta usando exclusivamente esses documentos como base. É como a diferença entre um estagiário que responde "de cabeça" (IA genérica) e um que primeiro pesquisa nos autos antes de responder (IA com RAG). Quando o RAG opera localmente — no seu computador, sem enviar dados para a nuvem — você tem o melhor dos dois mundos: inteligência artificial de ponta com sigilo absoluto.

Como a IA Especializada Funciona de Forma Diferente

Uma IA jurídica especializada como a Locus.IA não é simplesmente "um ChatGPT com prompt diferente". A arquitetura é fundamentalmente outra. Veja os diferenciais técnicos que mudam o resultado:

Processamento local: nenhum dado sai do seu computador

A Locus.IA roda diretamente na sua máquina. Seus documentos não trafegam para nenhum servidor externo. Isso elimina de uma só vez os riscos de LGPD, CLOUD Act e vazamento de dados. Para o advogado, significa poder alimentar a IA com contratos sigilosos, peças estratégicas e dados sensíveis sem nenhuma preocupação.

RAG local com seus documentos

Quando você faz uma pergunta à Locus.IA, o sistema primeiro busca nos documentos que você forneceu. A resposta é gerada a partir dessas fontes, com citação da origem. Se a informação não está nos documentos, a IA informa que não encontrou — em vez de inventar.

System prompts jurídicos calibrados

Por trás de cada interação, a Locus.IA opera com instruções de sistema (system prompts) especificamente desenhadas para o contexto jurídico brasileiro. Isso inclui: formatar respostas no padrão forense, priorizar legislação vigente, evitar afirmações sem base documental e manter o tom técnico adequado ao judiciário.

Ancoragem em documentos (Document Grounding)

Cada afirmação que a IA faz pode ser rastreada até o trecho específico do documento que a originou. Isso é o oposto de uma alucinação: é uma resposta com lastro verificável. Você pode clicar na citação e confirmar nos autos.

Na Prática: Antes e Depois

Veja a diferença real entre pedir a mesma coisa para uma IA genérica e para uma IA especializada com RAG:

Cenário: Você pede um resumo das cláusulas de rescisão de um contrato de prestação de serviços

ChatGPT (IA Genérica)Problema: A resposta é genérica, não analisa o SEU contrato. Cita o art. 473 do CC de forma correta, mas ignora completamente as cláusulas específicas que podem prever multa rescisória de 20%, aviso prévio de 90 dias ou foro de eleição diferente. Você recebe uma aula de direito, não uma análise do caso.

Diferença: A resposta analisa o documento real, cita cláusulas específicas, calcula valores e indica o foro correto. Nenhuma informação é inventada.

Cenário: Você pede jurisprudência sobre danos morais por inscrição indevida no SPC

ChatGPT (IA Genérica)Problema: O número do REsp pode estar correto ou pode ser uma alucinação. Você precisaria verificar manualmente. E se o modelo inventar, você pode citar um julgado que não existe em uma petição — exatamente como aconteceu no caso Mata v. Avianca.

Diferença: A IA cita apenas o que está na base fornecida e avisa quando não encontra algo, em vez de inventar.

Comparativo Completo: IA Genérica vs IA Especializada

| Critério | ChatGPT / Gemini / Copilot | Locus.IA (RAG Local) |

|---|---|---|

| Onde os dados trafegam | Servidores nos EUA (sujeito ao CLOUD Act) | Processamento 100% local, no seu computador |

| Conformidade LGPD | Transferência internacional sem base legal clara | Nenhum dado pessoal sai da máquina |

| Risco de alucinação | Alto — inventa jurisprudência com confiança | Mínimo — respostas ancoradas nos seus documentos |

| Citação de fontes | Imprecisa ou fabricada | Rastreável até o trecho do documento original |

| Análise de contratos | Genérica, baseada em templates da internet | Específica ao documento fornecido, com valores e cláusulas |

| Sigilo profissional | Comprometido (dados podem treinar o modelo) | Preservado integralmente |

| Custo | Grátis a US$ 20/mês | Investimento profissional com retorno em produtividade |

| Quem é responsável pelo erro | Você, o advogado (não a OpenAI) | Você, o advogado — mas o risco de erro é drasticamente menor |

A Arte do Prompting Jurídico: Como Extrair o Máximo da IA

Mesmo com a melhor IA do mundo, o resultado depende da qualidade da instrução que você fornece. O chamado prompting — a forma como você formula perguntas e instruções para a IA — é uma habilidade que separa o advogado que "brinca" com IA daquele que realmente a incorpora na prática.

Veja a diferença:

Dicas práticas para prompting jurídico eficaz:

- Seja específico sobre o documento: Indique qual arquivo analisar e quais cláusulas priorizar.

- Defina o formato da resposta: Tópicos, tabela comparativa, texto corrido, minuta de petição.

- Estabeleça limites: "Responda apenas com base no documento fornecido" ou "Se não encontrar a informação, avise em vez de supor."

- Forneça contexto processual: Fase do processo, tipo de ação, instância, perfil do juízo.

- Itere: A primeira resposta raramente é a final. Refine, peça mais detalhes, questione as conclusões.

Quando a IA Genérica é Suficiente vs Quando é Perigosa

Seria desonesto dizer que você nunca deve usar o ChatGPT. Há cenários em que ele é perfeitamente adequado — e outros em que o risco é inaceitável:

IA genérica é aceitável para:

- Redigir e-mails internos não-confidenciais

- Pesquisar conceitos jurídicos básicos (estudo pessoal, não citação em peças)

- Gerar ideias de estrutura para artigos ou apresentações

- Traduzir textos jurídicos de referência (sem dados sensíveis)

- Brainstorming de teses — desde que você verifique tudo depois

IA genérica é perigosa para:

- Pesquisar jurisprudência para citar em peças processuais

- Analisar contratos com dados reais de clientes

- Redigir petições, recursos ou pareceres

- Trabalhar com informações sujeitas a sigilo de justiça

- Qualquer tarefa cujo erro pode gerar sanção, multa ou prejuízo ao cliente

- Análise de documentos com dados pessoais sensíveis (saúde, financeiros, criminais)

"A inteligência artificial não substitui o advogado. Mas o advogado que usa a IA certa vai substituir o que usa a IA errada."

O Caminho Seguro: IA Especializada Com Processamento Local

A questão não é se você vai usar IA na advocacia — você já usa ou em breve usará. A questão é qual IA você vai usar e como.

A combinação de RAG local + processamento no seu computador + system prompts jurídicos calibrados não é um luxo tecnológico. É o padrão mínimo de diligência que o cenário regulatório brasileiro está começando a exigir. A Resolução 615/2025 do CNJ, as diretrizes da ANPD e a crescente vigilância dos tribunais sobre uso de IA em peças processuais deixam claro: o advogado que não se adaptar vai ficar para trás — ou, pior, vai enfrentar sanções.

A Locus.IA foi construída para resolver exatamente esse problema. Não é um chatbot genérico com skin jurídica. É uma ferramenta profissional que entende as necessidades, os riscos e as responsabilidades da advocacia brasileira.

📌 Artigos Relacionados

Chega de arriscar com IA genérica

Teste a Locus.IA por 14 dias. Sem enviar dados para nuvem. Sem risco de alucinações em peças. Sem violar a LGPD. Descubra o que uma IA realmente feita para advogados pode fazer pelo seu escritório.

Começar teste gratuito de 14 diasSem cartão de crédito. Instalação em 5 minutos. Suporte humano incluso.