Em 2023, nos EUA, advogados foram multados por citar 6 processos fictícios gerados pelo ChatGPT em uma petição federal. Os processos não existiam. O ChatGPT os inventou com nomes plausíveis, datas e ementas convincentes. No Brasil, o risco é o mesmo. A solução chama-se RAG — e este artigo explica por que ela é essencial para qualquer advogado que use IA.

O problema de alucinação em IA jurídica não é teórico — é documentado e recorrente. Modelos de linguagem como ChatGPT, Gemini e Claude são treinados para gerar texto plausível, não para verificar fatos. Quando não sabem a resposta, inventam com confiança.

O Caso Mata v. Avianca: A Lição Que Todo Advogado Deve Conhecer

Em maio de 2023, o juiz P. Kevin Castel (Tribunal Federal do Distrito Sul de Nova York) multou os advogados Roberto Mata e Steven Schwartz após descobrir que uma petição continha seis citações de jurisprudência fictícia gerada pelo ChatGPT.

Os advogados usaram ChatGPT para pesquisar precedentes, incluíram os casos na petição sem verificar e, quando questionados pelo juiz, apresentaram "confirmações" do ChatGPT — que continuou inventando detalhes para sustentar os casos fictícios.

Os advogados foram multados em USD 5.000 e obrigados a enviar cópias da ordem judicial a todos os juízes citados nos casos fictícios.

Por Que IA Alucina Jurisprudência?

Para entender a solução, é preciso entender o problema. Modelos de linguagem como ChatGPT funcionam prevendo qual texto é mais provável dado um contexto. Quando você pergunta "cite casos do STJ sobre cláusula penal abusiva", o modelo:

- Gera texto que parece uma resposta jurídica válida

- Usa padrões aprendidos de como jurisprudência é formatada

- Inventa números de processo plausíveis (porque não tem acesso ao banco de dados real)

- Cria ementas que soam corretas para o tema perguntado

- Apresenta tudo com mesma confiança de informações verdadeiras

O modelo não sabe que está inventando — ele gera o texto mais provável, e texto que parece jurisprudência real é mais "provável" do que admitir que não sabe.

O Que É RAG e Como Resolve o Problema

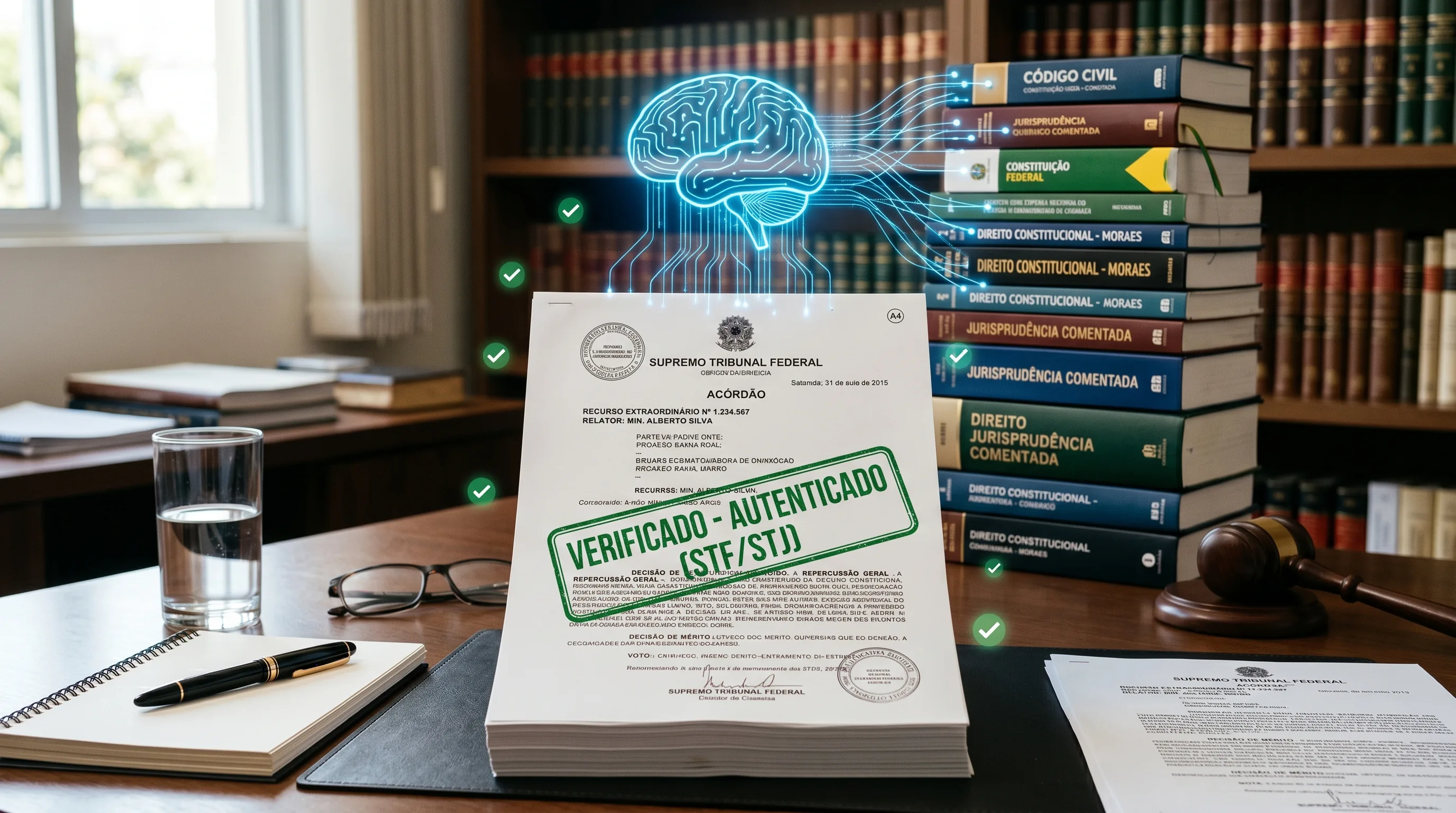

RAG — Retrieval-Augmented Generation (Geração Aumentada por Recuperação) — é uma técnica que conecta o modelo de linguagem a uma base de documentos reais antes de gerar qualquer resposta.

Como RAG funciona na prática

Com RAG, a IA não inventa — ela recupera e sintetiza. Se não há informação relevante na base, o modelo responde que não encontrou, em vez de fabricar uma resposta.

Como Verificar Jurisprudência Citada por IA — Protocolo Seguro

Mesmo com RAG, todo advogado deve verificar jurisprudência antes de citar em peça processual:

- 01STF: Acesse jurisprudencia.stf.jus.br e pesquise pelo número de processo ou termos da ementa

- 02STJ: Acesse stj.jus.br/sites/portalp/Jurisprudencia e verifique o número exato do processo

- 03TRTs e TJs: Use o portal do tribunal específico ou o PJe/eProc do tribunal

- 04Se não encontrar: Nunca cite. Uma busca sem resultado = jurisprudência possivelmente inventada

Perguntas Frequentes

Recursos Oficiais

📍 STF — Jurisprudência:

jurisprudencia.stf.jus.br — Pesquisa de acórdãos, súmulas vinculantes e decisões monocráticas.

📍 STJ — Jurisprudência:

stj.jus.br — Pesquisa de acórdãos e súmulas do Superior Tribunal de Justiça.

📍 CNJ — Resolução 332/2020 (IA no Judiciário):

cnj.jus.br — Princípios para uso ético de IA: explicabilidade, não discriminação e responsabilidade.

IA Jurídica que Cita a Fonte Real em Cada Parágrafo

Locus.IA usa RAG para analisar seus documentos reais — não inventa jurisprudência porque trabalha com o que você fornece. Cada afirmação vem com a fonte exata do documento original.

Conhecer Locus.IA →📌 Leia Também

- IA Jurídica em 2026: Guia Definitivo

- Quanto Custa uma IA Jurídica? Preços 2026

- Como Contratar IA para Advocacia: Checklist

- Como Assinar uma IA Jurídica em 2026

- Como Peticionar com IA de Forma Segura

- Petições com IA: Guia Prático

- IA para Petições: Guia Completo 2026

- Alucinações de IA em Tribunal: Riscos Reais

- IA no Processo Trabalhista 2026