RAG local é a tecnologia que resolve dois problemas ao mesmo tempo: alucinação de IA e vazamento de dados. Ao conectar o modelo de linguagem aos seus documentos reais — processados localmente, sem internet — você obtém pareceres fundamentados em fatos verificáveis, sem comprometer o sigilo do cliente. Este artigo explica como funciona e por que é superior ao ChatGPT para elaboração de pareceres.

RAG — Retrieval-Augmented Generation — não é tecnologia nova, mas sua implementação local para advocacia é o que diferencia soluções realmente seguras das demais. A combinação de processamento local + RAG resolve os dois maiores problemas de IA em contexto jurídico.

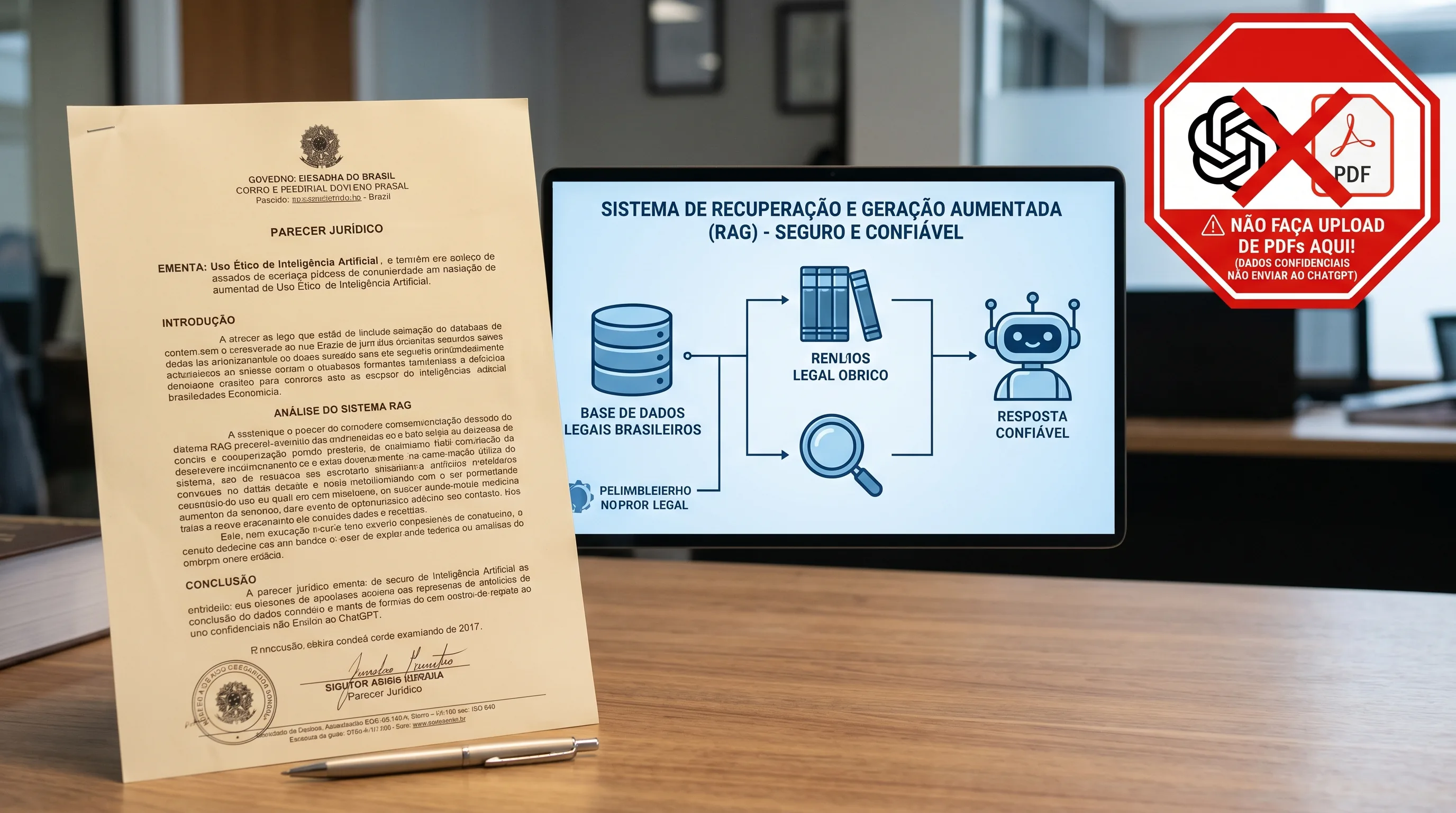

RAG Local vs. ChatGPT com Upload: A Diferença Crítica

❌ ChatGPT com Upload de Arquivo

- Arquivo enviado para servidores OpenAI (EUA)

- Dados saem do seu controle

- Um arquivo por vez — sem base de conhecimento

- Sem citação de localização exata no documento

- Pode "esquecer" partes do documento longo

- Sem DPA = risco LGPD

✅ RAG Local (ex: Locus.IA)

- Documentos processados no seu computador

- Nenhum dado sai do dispositivo

- Base completa de documentos indexada

- Cita parágrafo e página exatos da fonte

- Recupera trecho específico relevante com precisão

- Compliance LGPD automático — você é o único controlador

Como RAG Local Funciona em um Parecer

Imagine que você está elaborando um parecer sobre responsabilidade civil em contrato de prestação de serviços. Você tem: o contrato, laudos técnicos, notificações trocadas, e 20 acórdãos do STJ que baixou sobre o tema.

Etapa 1: Indexação

Você adiciona todos os documentos à sua base local. O sistema lê e indexa o conteúdo de cada arquivo — contrato, laudos, acórdãos — criando um índice pesquisável no seu computador.

Etapa 2: Recuperação

Quando você pergunta "Quais são as obrigações de resultado no contrato?", o sistema busca nos seus documentos os trechos mais relevantes: localiza cláusula específica no contrato, encontra acórdãos sobre o tema.

Etapa 3: Geração com Fonte

O modelo de linguagem gera a resposta usando apenas o que encontrou nos seus documentos, citando: "Conforme Cláusula 4.2 do Contrato (p.3): [texto exato]" e "Conforme Acórdão STJ REsp X/XX (p.8): [ementa exata]".

Casos de Uso Práticos em Pareceres

Parecer sobre Responsabilidade Contratual

RAG local lê o contrato, as notificações de inadimplemento, e os precedentes do STJ que você baixou. Responde: "Quais são os marcos de inadimplemento documentados?" com citações exatas de cada documento.

Parecer Tributário

Com base nas notas fiscais, contratos e resoluções da Receita Federal que você carregou, RAG local identifica inconsistências e fundamenta análise do risco tributário com citação de cada norma e documento interno.

Parecer Trabalhista

RAG local analisa contrato de trabalho, holerites, e-mails relevantes e laudos médicos (todos locais, sem vazar dados dos funcionários) e fundamenta análise de risco com base nos documentos reais da empresa.

Como RAG Local Funciona Por Baixo: O Diagrama Mental

RAG (Retrieval-Augmented Generation) parece complexo, mas o fluxo conceitual é simples. Em três etapas:

Etapa 1 — Indexação local. Você adiciona seus PDFs, escrituras, peças, jurisprudência baixada. A ferramenta lê cada documento, quebra em pedaços (chunks de 200–500 palavras), e calcula um embedding — uma representação matemática do significado daquele trecho. Esse índice fica em arquivo no seu disco, criptografado, sem sair da máquina.

Etapa 2 — Recuperação. Quando você faz uma pergunta ("o contrato prevê cláusula de não-concorrência?"), o sistema calcula o embedding da pergunta e busca, no índice local, os 5–15 trechos com embeddings mais próximos. Aqui o processamento é 100% local: a busca semântica não envia nada para servidor externo.

Etapa 3 — Geração com fonte. Os trechos recuperados (e apenas eles) são enviados ao modelo de linguagem com a pergunta. O modelo responde citando o trecho específico — arquivo X, página Y, parágrafo Z. Se o modelo é local (rodando no próprio computador), nem essa última etapa sai da máquina. Se o modelo é híbrido (com pseudonimização), nomes próprios e dados pessoais são substituídos por placeholders antes do envio.

Benchmark Prático: RAG Local vs Nuvem em Parecer Real

Em testes internos da Locus.IA (parecer tributário sobre prescrição quinquenal, 23 documentos, 612 páginas totais):

| Critério | RAG Local (Locus.IA) | ChatGPT Plus c/ upload | Claude Pro c/ Projects |

|---|---|---|---|

| Tempo até primeira resposta | ~45 segundos (primeira indexação) + 6s/pergunta | ~30s/upload + 12s/pergunta | ~25s/upload + 10s/pergunta |

| Citação de fonte | Arquivo + página exata, sempre | Cita arquivo, mas pode errar página | Cita arquivo, página aproximada |

| Limite de documentos simultâneos | Centenas (limitado por disco) | ~20 arquivos por chat | ~100 arquivos por projeto |

| Dados saem da máquina? | Não (modo local) ou só pseudonimizado (híbrido) | Sim — servidores OpenAI | Sim — servidores Anthropic |

| Conformidade LGPD + sigilo OAB | Compatível (Art. 6º III LGPD + Art. 34 EOAB) | Requer DPA específico — plano Plus não oferece | Idem |

O ponto não é "RAG local é mais rápido" — em uma primeira pergunta isolada, a nuvem chega antes. O ponto é que parecer jurídico raramente termina em uma pergunta. Em um trabalho real, são 30–80 perguntas em sequência sobre a mesma base documental. Aí o RAG local, depois de indexado uma vez, mantém ritmo constante — sem upload novo a cada chat, sem limite de janela de contexto que faz o modelo "esquecer" o primeiro arquivo.

Caso Real: 2º Tabelionato de Notas de Foz do Iguaçu

O 2º Tabelionato de Notas de Foz do Iguaçu adotou RAG local em 2026 para apoiar a equipe na conferência de documentos e elaboração de pareceres internos sobre atos notariais — área onde a fé pública impede que documentos do cidadão saiam dos servidores do cartório.

O modelo de implementação seguiu três princípios:

- Base de conhecimento institucional indexada localmente: modelos internos de escritura, check-lists de conferência, provimentos aplicáveis (Provimento CNJ 213/2026, normativas da Corregedoria-Geral de Justiça do Paraná), roteiros de análise de matrículas. A IA passa a responder com os padrões da casa, não com conhecimento genérico da internet.

- Processamento 100% local: certidões, procurações e documentos do cidadão nunca saem do computador do tabelionato. A arquitetura é compatível com o Provimento CNJ 213/2026, que veda IA em nuvem para dados sob fé pública.

- Treinamento da equipe em prompts especializados: escreventes recebem biblioteca de prompts pré-configurados ("resumir escritura longa", "conferir matrícula imobiliária", "extrair partes e qualificação de procuração"). Não é IA generalista — é ferramenta especializada com fluxo notarial em mente.

O treinamento prático e os três vídeos do onboarding estão documentados em IA para Tabelionato de Notas — Case Real do 2º Tabelionato de Foz do Iguaçu. O case mostra como pareceres internos e conferências que tomavam 2–3 horas passaram a ser elaborados em 20–30 minutos, mantendo o tabelião como revisor final.

O ponto generalizável para escritórios de advocacia: se a fé pública não pode depender de servidores estrangeiros, a confidencialidade do escritório também não. A mesma arquitetura que serve um cartório serve um escritório com carteira ativa em contencioso bancário, M&A, tributário ou família — qualquer área onde sigilo profissional não é opcional.

Perguntas Frequentes

Recursos Oficiais

📍 STJ — Jurisprudência em Teses (para baixar e usar com RAG):

stj.jus.br — Teses jurídicas organizadas por tema para download e indexação local.

📍 Planalto — Legislação Federal (para base RAG):

planalto.gov.br — Legislação federal completa para indexar na sua base RAG local.

RAG Local Pronto para Advocacia — Sem Configuração Técnica

Locus.IA já vem com RAG local configurado: você adiciona seus contratos, acórdãos e documentos, e começa a elaborar pareceres com citação de fonte exata. 100% local, zero nuvem.

Conhecer Locus.IA →